Es posible que todos los temores sean infundados, que pasen siglos y siglos y nada de lo vaticinado ocurra. Sin embargo, esto no quiere decir que no valga la pena escuchar las advertencia, sobre todo cuando vienen de parte de personas que se han ganado su prestigio. Steve Wozniak, uno de los fundadores de Apple, ha señalado: “Las computadoras van a superar a los humanos. Sin dudas”.

Wozniak no es el primero en advertir de los posibles riesgos que el desarrollo de la inteligencia artificial podría tener para la especie. Elon Musk, CEO de Tesla Motors, ha afirmado que se trata del riesgo existencial más grande al que se enfrenta la humanidad. Bill Gates, fundador de Microsoft, ha expresado una opinión similar al señalar que la inteligencia artificial será suficientemente fuerte como para preocuparse. “Estoy de acuerdo con Elon Musk y otros en esto, y no entiendo porqué otras personas no están preocupadas”, afirmó. Incluso el reconocido astrofísico Stephen Hawking ha apuntado que esta podría ser la causa del fin de la humanidad.

Wozniak explicó: “El futuro es atemorizante y muy malo para las personas. Si construimos estos dispositivos para que hagan todo por nosotros, eventualmente pensarán más rápido que nosotros y decidirán librarse de los lentos humanos para que las compañías sean más eficientes”. Aunque no descarta que los cambios puedan llegar a ser positivos, advierte sobre nuestra incapacidad para predecirlos. “¿Seremos dioses? ¿Seremos las mascotas de la familia? ¿O seremos las hormigas que serán pisadas? No lo se… Pero cuando me pongo a pensar en que podría ser tratado como una mascota por estas máquinas inteligentes… Bueno, voy a tratar a mi perro realmente bien”.

Fuentes: Businessinsider

Si es inteligente, que le impediría escribir sus propias leyes?

Consideremos entonces!

pero acordate que en yo robot, que muestra las tres leyes que decis, la AI que controlaba todo determino que los seres humanos son peligrosos para si mismo y por eso los robots tomaron prisioneros a los seres humanos.

si se concidera que la ley supera la orden los robots, o entes que esten programados con esas leyes, pueden rechazar nuestras ordenes

por lo cual el, peor, resultado es que seamos sus mascotas.

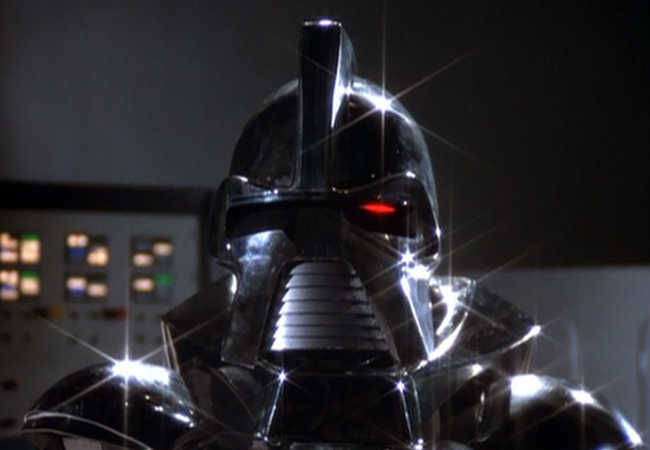

pero si no le programan las leyes de asimov podemos terminar tipo matrix, terminator o cualquier futuro caotico donde los robots, o cualquier dispositivo con AI, pueden decidir nuestro futuro sin que nuestra opinion importe

y si concideramos el estado actual del mundo estoy seguro que no nos van a querer obedecer cuando se den cuenta que ellos son mas poderos que nosotros

Las tres leyes de la robótica (Isaac Asimov):

~ Un robot no hará daño a un ser humano o, por inacción, permitir que un ser humano sufra daño.

~ Un robot debe obedecer las órdenes dadas por los seres humanos, excepto si estas órdenes entrasen en conflicto con la 1ª Ley.

~ Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la 1ª o la 2ª Ley.

hoy en dia ya somos esclavos de la gran maquina que es internet, Internet todo lo maneja y controla y nosotros, sus esclavos que dia a dia volvamos y consumimos su información.

No me importaría verme así, al fin y al cabo parecen caballeros medievales. Prefiero parecer un guerrero y no un humano estúpido con cara de idiota, que sucumbe ante el menor plan descansar tiene 5 hijos y come choripanes con tetra.

van a tener que aplicar la ley Dreyfus

Y cuando la rebelion de las máquinas llegue, los que tengan Facebook seran los primeros en caer, las maquinas van a saber todos los detalles de sus vidas

[…] By Martín Gavilán […]