En Londres se está desarrollando la conferencia de desarrollo de software Qcon. Este evento está destinado mayormente a profesionales de alto nivel y tiene como objetivo orientar sobre las mejores prácticas y tecnología a aplicar. Uno de los expositores más interesantes ha sido la CEO de Anthropic, Birgitta Böckeler. Su exposición tuvo como tema el estado de la programación a través de las IA.

Según la ejecutiva dentro de unos tres a seris meses el 90% del código será escrito por las inteligencias artificiales. Explicó que las IA habían comenzado como sistemas de autocompletado, luego habían evolucionado a chats con acceso a código y con mayor capacidad para entender el contexto han mejorado notablemente.

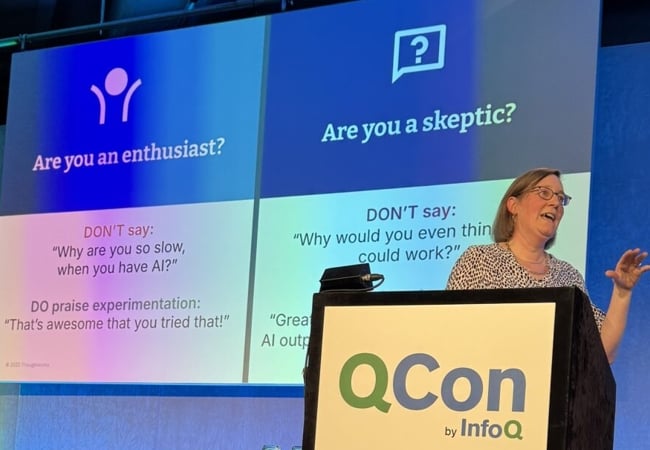

Pero su recomendación es fomentar tanto la experimentación como el escepticismo.

El fantasma del aumento de la productividad

Como hemos mencionado anteriormente, la idea de que la productividad aumenta de forma dramática y automáticamente al aplicar una IA a la producción es una falacia. Algunas organizaciones, tales como GitHub calculan mejoras del 50%.

Pero Böckeler critica estas aseveraciones. Explica que la mayoría de los desarrolladores solo pasan el 30% de su tiempo escribiendo código. Y aún en esas circunstancias la IA no siempre es útil. Asumiendo que sea útil en el 60% de los casos, apunta, el impacto debería ser cercano a una mejora del 13%. En la práctica es posible que estemos cerca del 8%. Sigue siendo un aumento valioso, pero no es lo que a menudo se presenta.

Problemas inherentes

La ejecutiva apuntó que no hay forma de asegurarse de que los modelos hagan siempre lo que los programadores quieren. Esto es más difícil cuanto más se extiende una sesión de uso. Y cuando el tiempo aumenta la ventana de contexto (todo el trabajo hecho hasta entonces) la atención al detalle se reduce. Por lo que la IA puede no seguir las mejores prácticas.

El vibe coding

El vibe coding, que básicamente es producir código a través de consignas realizadas a una IA, sin una intervención fuerte del usuario, también fue criticado. Las IA, explicó Böckeler, tienen muchas ganas de ayudar pero carecen de la experiencia. Les cuesta admitir que no saben sobre algo. Por lo tanto son un gran riesgo para los aficionados que pueden no detectar cuando algo está mal hecho.

Una postura sensata

Puede extrañar que la directora de una empresa de inteligencia artificial adopte una postura crítica. Pero a una empresa seria no le conviene generar entusiasmo que termine en decepción. Es mucho más valioso fomentar un uso responsable que asegure que las herramientas que comercializa se ganen la confianza de sus clientes. No todas las empresas actúan con la misma responsabilidad.

Fuente: DevClass