Un grupo de cinco estudiantes de Ingeniería de la Universidad de La Matanza (UNLaM) creó Onis, un software para Windows que utiliza la cámara de Kinect y traduce en pantalla el lenguaje de señas argentino (LSA). De esta manera, permite establecer una comunicación entre personas sordas con sus allegados que no sepan el lenguaje.

“Comenzamos a tirar ideas y, dentro de las sugerencias, los profesores seleccionaron esta idea. El objetivo es que una persona oyente no requiera saber el lenguaje de señas para comunicarse con una persona sorda, quien a su vez pueda comunicarse con señas. También sirve para aprender la lengua de señas”, indicaron a RedUSERS los integrantes del equipo, conformado por: Christian Bermúdez, Érika Garrido, Marcelo Canella, Natalia Lara y Nelson Juárez.

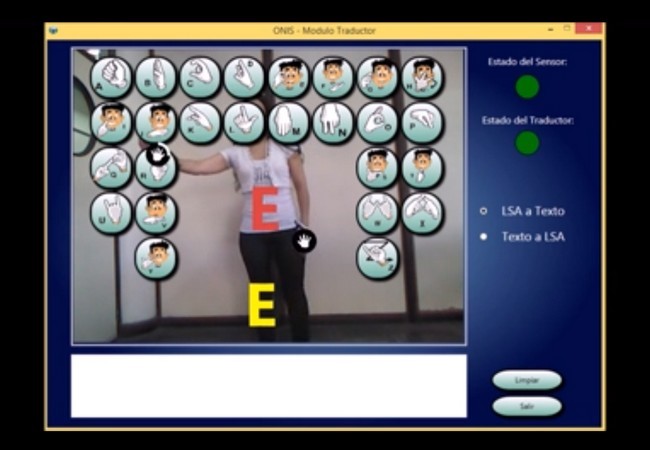

El producto tiene dos funciones. La primera es un traductor, donde el usuario realiza una seña y del otro lado llega texto, mientras que en el segundo modo alguien escribe y representan en el monitor las señas mediante imágenes. Una tercera funcionalidad es el módulo de chat.

“Estamos trabajando con las escuelas de enseñanza especial 513 y 517, con quienes vamos probando el programa, la interfaz y cómo se realizan las señas. Nos estamos asesorando con ellos. También nos ayudó el Centro Dar, que nos ofreció todos los contactos para arrancar con el proyecto”, añadieron los chicos.

Allí descubrieron que las personas sordas se sienten muy integradas en la escuela, pero no fuera de ella. Incluso hallaron el caso de un chico sordo de 20 años y que la familia no sabía cómo hablarle. “La peor discriminación que sufren es en el hogar”, aseguraron los chicos, que terminaron Onis en seis meses dentro de la materia Proyecto, con la que se reciben los alumnos de Ingeniería de la UNLaM.

A la hora de mencionar el mayor desafío, los estudiantes coincidieron en las limitaciones deKinect. “Kinect no detecta los dedos, sino que detecta un sólo punto que es la mano y en base a eso tuvimos que detectar los dedos para saber qué letra se está queriendo decir“, explicaron.

Según comentaron, Kinect sólo detecta 10 puntos del cuerpo de la cintura para arriba. Por ello, pusieron en práctica conocimientos de matemática discreta, como distancia entre puntos y ángulos. Y programaron el software con Visual Studio 2010 en C#.

Lo destacable del producto es que funciona en computadoras cuyo único requisito sea que puedan correr Windows 7 y 8. De hecho, utilizaron como banco de pruebas una desktop con procesador Celerom de 1,8 GHz y 1 GB de memoria, una configuración fácilmente superable por la mayoría de las notebooks que se consiguen en el mercado actual.

“Dejamos un montón de cosas de lado para poder desarrollarlo y nos gustaría que Onis esté disponible para todas las personas que lo necesiten. No sólo para ellos, sino también para sus familiares, amigos. Suelen estar aislados y tener pocas chances laborales, porque no se pueden comunicar, y esto podría ayudarlos”, destacaron los creadores de Onis.

Además, remarcaron que les gustaría seguir con el proyecto, porque es “algo que ayuda”, pero cómo sólo se trata de un proyecto universitario necesitarían algún tipo de apoyo para continuarlo y, por ejemplo, trabajar en una versión mobile.

El proyecto puede verse funcionando en ExpoProyecto, la feria de proyectos que estará hasta el 31 de octubre en la Universidad de La Matanza. Y también pueden verla en acción en el siguiente video:

oye me puedes explicar como hisistes tu Softwre de sordos xfa amig

Si. Pero todavía no se ha visto en funcionamiento. Lo que se ve en esta nota es que estas personas hicieron algo que ya se puede usar si los apoyamos.

Gracias por leer la nota!. Saludos!!

He visto proyectos mucho mejores en la expo de este año y no estuvieron cubiertos por la revista, flojo la verdad

Microsoft también tiene su propio proyecto http://www.xatakawindows.com/telecomunicaciones/kinect-sign-language-translator-el-futuro-segun-microsoft

paso a paso, nadie nace sabiendo todo entre todos podremos crear el lenguaje de seña dependiendo de la región otra cosa, si aportamos como tu dice, se debería hacer un botón o comando para que cuando se este frente a una nueva señal se almacene con su respectivo significado, y se reemplaza, la seña que venga predeterminada.

[…] igual que el software traductor del lenguaje de señas argentino Onis, esta aplicación fue desarrollada en sólo seis meses dentro del marco de la asignatura Proyecto, […]

Sinceramente.. UN ORGULLO. La idea es genial por la aplicación que le dan al dispositivo. Ampliará mucho la comunicación. GRACIAS

[…] Fuente: redUSERS […]

A mi también me parece muy bien, es nada más que se puede mejorar. Algo que hay que aprender es que un mal diseño desde el principio es un ancla para adelante.

Sayo, no te olvides que es un proyecto universitario, que es una materia que lo hacen mientras cursan otras. Hacer esto en 6 meses, mientras trabajan, cursan otras materias me parece genial.

1- Linux lo tienen el 1% de las PCs, no tiene sentido invertir

¿Vos sabes cuantos teléfonos y tablet con Android se activan por día?¿sabes que Android usa Linux?

Solo HP y solo contando en India HP vendió 1.500.000 CPUs con Ubuntu preinstalado.

http://phx.corporate-ir.net/phoenix.zhtml?c=71087&p=AnalystMeeting2013

De la página anterior abren el informe en PDF y buscan Ubuntu (pag 33). Es el informe oficial para el inversor.

2-Ya se que Kinect no es una cámara común, por eso lo interesante era hacer el proyecto con una camara común y usar las librerías de de reconocimiento.

3- la idea es no usar Kinect, y no estoy tan seguro que no alcance el un procesador ARM para hacer esto.

4-Idem

5- pero lo están haciendo ellos, y la critica es “constructiva” para que mejoren el diseño de el proyecto y sea más útil. nada más.

La idea no es desmerecer lo que hicieron, sí no aportar para que lo mejoren

Otro que no entiende nada:

1- Linux lo tienen el 1% de las PCs, no tiene sentido invertir

2- Kinect no es una camara comun, lee un poco antes

3- Se necesita mucha capacidad de procesamiento para usar Kinect, no va con un telefono (por ahora)

4- KINECT tiene un costo de 250 dolares solamente, eso es limitado??

5- HACELO VOS!

Felicitaciones, es muy bueno que todos nos comuniquemos mejor y esta herramienta rompe una barrera con los que no conocemos el lenguaje de señas.

#OrgulloUNLAM

Interesante el proyecto.

Creo que tienen que hacer una página propia, y no usando Facebook.

Lamentablemente está muy limitado por usar Kinect y no una una librería gestual para usar con cámaras comunes. Tambien usaron un ambiente solo para Windows con lo cual dejaron todas las otras plataformas de lado. (Linux en general y Android en particular). Se podría haber hecho un “aparato” específico con Arduino para este tema.

Hay una librería libre (multiplataforma) que reproduce en voz todo lo escrito, sería un siguiente paso.

Pensar que la Presidente argentina en Harvard subestimó a la Universidad de la Matanza… ¡bien por los estudiantes! Yo mismo soy hipoacúsico y cuando estoy con sordos, hablo en LSA (lengua de señas argentina). Gracias mil, chicos, por mi gente. 🙂

Muy bueno, el nuevo kinect que esta desarrollando MS va a detectar los dedos ahi lo van a poder mejorar bastante

Muy buen proyecto, pero creo que la idea mas clara seria que en las imagenes para los sordos tambien sean frases ya que ellos se comunican mejor con gestos. ya tienen la funcion que traduce de seña a texto lo unico que faltaria es que se agrege la funcion de texto o habla a señas

Una gran emocion chicos,sigan asi que son el ejemplo de muchos estudiantes de ingenieria,es un gran proyecto,no duden en continuarlo!!

Quienes quieran apoyar nuestro proyecto estamos en: http://www.facebook.com/ProyectoOnis

Seguramente encontraran inversores de manera rápida.

Este tipo de proyectos ya existe en el exterior desde hace un tiempo, pero potenciando el sistema con un buen diccionario corrector, grabación de conversaciones, más un precio verdaderamente competitivo se podrán expandir al mundo rápidamente.

También podrían tener tarifas diferenciadas para instituciones estatales y privadas…

Suerte con este grandioso proyecto chicos!

Van a tener que traducir las señas porque difieren según la región y el idioma.

Crei que el lenguaje de señas era universal, no sabía que hay un lenguaje para Argentina y otro para los demás idiomas.

Pero es la “Uni” de La Matanza! Una bsta según Kretina! Harvard debería haber producido este soft!

Increíble aporte de estos genios, espero que su proyecto se extienda por todo el mundo. Felicitaciones.